爬虫Robots协议的规定

发布时间:2023-01-30 09:33:06 264

相关标签: # 爬虫# 小程序

robots(也称为爬虫协议、机器人协议等)称是“网络爬虫排除标准”是网站跟爬虫间的一种协议,用简单直接的txt格式文本方式告诉对应的爬虫被允许的权限,也就是说robots.txt是搜索引擎中访问网站的时候要查看的第一个文件。

当一个搜索蜘蛛访问一个站点时,它会首先检查该站点根目录下是否存在robots.txt,如果存在,搜索机器人就会按照该文件中的内容来确定访问的范围;如果该文件不存在,所有的搜索蜘蛛将能够访问网站上所有没有被口令保护的页面。

网站开发者对于网络爬虫的规范的公告,你可以不遵守可能存在法律风险,但尽量去遵守。

Robots协议:在网页的根目录+robots.txt

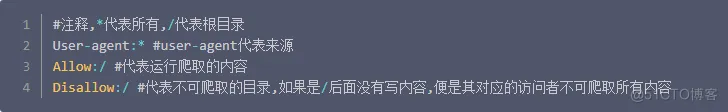

Robots协议的基本语法:(如图)

并不是所有网站都有Robots协议

如果一个网站不提供Robots协议,是说明这个网站对应所有爬虫没有限制

类人行为可以不参考robots协议,比如我们写的小程序访问量很少,内容也少但是内容不能用于商业用途

总的来说请遵守Robots协议。

文章来源: https://blog.51cto.com/u_13488918/6024810

特别声明:以上内容(图片及文字)均为互联网收集或者用户上传发布,本站仅提供信息存储服务!如有侵权或有涉及法律问题请联系我们。

举报